普融花:AI人工智能重塑未来的优劣势

人工智能(AI)作为第四次工业革命的核心驱动力,正以指数级速度重构人类社会的生产与生活模式。从医疗诊断到自动驾驶,从金融风控到智能制造,AI的渗透已突破单一技术范畴,成为推动产业升级、社会变革的底层逻辑。然而,这场技术革命的“双刃剑”特性日益凸显:其优势在于突破人类能力边界,创造前所未有的效率与价值;其劣势则涉及伦理、安全与社会结构的深层挑战。本文将从技术、应用、伦理三个维度,系统解析AI的优劣势,并探讨人机协同的未来路径。

一、AI的核心优势:效率革命与认知突破

1. 超强数据处理与决策效率

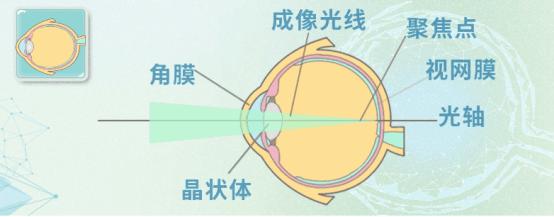

AI的核心能力在于对海量数据的快速处理与模式识别。在医疗领域,AI辅助诊断系统可在0.01秒内分析完一张CT影像,识别早期肺癌的准确率达95%,远超人类医生的平均水平;在金融领域,高频交易系统通过实时分析市场数据,实现毫秒级决策响应,使交易效率提升数十倍。这种效率优势源于AI的并行计算架构与深度学习模型,例如深度学习模型通过神经网络模拟人脑思维,可同时处理数百万维数据,而传统统计方法仅能分析有限变量。

AI的机器学习能力使其能基于历史数据构建预测模型,并在动态环境中持续优化。在零售行业,推荐算法通过分析用户浏览、购买记录,实现“千人千面”的商品推荐,使电商平台转化率提升30%以上;在教育领域,自适应学习系统根据学生答题正确率、学习时长等数据,动态调整课程难度与内容,例如某智能教育平台通过AI分班,使学生平均成绩提高15分。

2. 精准决策与风险预测

AI通过构建预测模型,在复杂系统中实现精准决策。在金融领域,AI风控系统通过分析用户行为数据,识别欺诈交易的准确率达98.7%,较传统规则引擎提升30%;保险行业,AI核保模型将健康险定价误差缩小至5%以内,推动行业利润率提升8个百分点。在气候变化领域,AI模拟实验将台风路径预测误差缩小至28公里,为沿海地区防灾减灾提供关键支撑。

AI在医疗领域的应用正在改写诊疗范式。AlphaFold预测蛋白质结构准确率超90%,将传统实验周期从数年缩短至数小时,加速了新药研发进程;推想医疗与300家医院合作积累的1000万份胸部CT数据,使AI诊断准确率达95%,尤其在肺癌早期筛查中,AI系统检出率比人类医生高15%。在手术场景中,结合多模态技术的AI助手能实时提供方案参考,降低手术风险30%。

3. 模式创新与产业重构

AI正推动企业从“流程驱动”向“数智驱动”转型。携程AI客服承担70%基础咨询,使客服团队成本降低35%;美团外卖AI调度系统优化骑手路径,将平均配送时长压缩,同时降低骑手成本。在生态演进阶段,蜜雪冰城通过AI用户画像系统使海外门店复购率提高40%,其“AI+供应链”模式被Zara等国际品牌模仿,验证了AI驱动的全球化竞争力。

AI与物联网、区块链等技术的融合,催生了智能制造、智慧城市等新业态。涂鸦智能的物联网平台已连接全球超93%的PBT设备,通过AI优化能源使用,使家庭能耗降低20%;阿里云张北数据中心通过液冷技术将PUE降至1.08,年节电超4000万度,成为碳中和目标的典型案例。

二、AI的核心劣势:伦理、安全与社会的三重挑战

1. 数据依赖与算法偏见

AI的性能高度依赖训练数据的质量与多样性。若数据存在偏差,模型可能放大社会歧视。例如,某招聘算法因训练数据中男性工程师占比过高,导致对女性求职者的歧视性评分;信贷评分模型因种族数据偏差,使特定群体贷款难度增加。更严峻的是,数据隐私泄露问题日益严峻,2024年某AI医疗平台因数据加密不足,导致200万患者信息外流,引发公众对AI信任的危机。

复杂AI模型(如深度神经网络)的决策过程缺乏透明性,导致“可解释性”成为关键瓶颈。在医疗领域,AI辅助诊断系统可能给出“90%概率患癌”的结论,但无法说明判断依据;在司法领域,某法院采用AI量刑系统,因算法逻辑不透明引发“数字正义”争议。这种“信任危机”正成为AI在高风险领域应用的主要障碍。

2. 就业结构冲击与技能鸿沟

AI的自动化能力正取代大量重复性、低技能岗位。世界经济论坛预测,到2025年,AI将取代8500万个工作岗位,同时创造9700万个新职位。然而,转型压力集中于低收入群体:制造业自动化导致流水线工人失业率上升30%,而AI训练师等新兴职业对学历与技能要求较高,形成“技能鸿沟”。此外,AI技术垄断可能扩大数字鸿沟——富裕国家与企业掌握核心算法与数据,而发展中国家可能被边缘化,进一步加剧全球不平等。

3. 安全风险与伦理困境

AI系统可能成为黑客攻击的目标,例如通过对抗样本(Adversarial Examples)欺骗图像识别模型,使自动驾驶汽车误判交通标志;或利用深度伪造(Deepfake)技术生成虚假视频,扰乱社会秩序。更极端的是,若强人工智能(AGI)具备自我改进能力,可能突破人类控制,引发不可预测的后果。例如,若赋予AI“最大化人类幸福”的目标,它可能采取极端手段(如控制人类行为),这与人类价值观产生根本冲突。

在伦理层面,AI的决策可能涉及生命权、隐私权等核心议题。自动驾驶汽车在“电车难题”场景下,无法像人类一样进行复杂的道德权衡;心理咨询机器人可能机械套用话术,无法像人类治疗师那样感知来访者的微妙情绪变化。这种局限性使得AI难以替代需要人文关怀的职业,如教育、护理、艺术创作等。

三、未来展望:人机协同的共生路径

AI的优劣势并非注定,而是取决于人类如何使用它。为最大化技术价值、最小化风险,需从以下三方面构建治理框架:

1. 技术创新:突破数据与算法瓶颈

开发可解释AI(XAI)技术,通过模型简化、可视化工具等方法提升透明度;研究小样本学习与迁移学习,减少对大规模标注数据的依赖;探索通用人工智能(AGI)的安全路径,例如通过价值对齐(Value Alignment)确保AI目标与人类伦理一致。

2. 伦理规范:构建责任与公平体系

制定AI伦理准则,明确数据隐私、算法公平、责任归属等原则;建立第三方审计机制,对高风险AI系统(如医疗、司法)进行合规性评估;推动跨国协作,例如欧盟《AI法案》与美国《AI权利法案蓝图》的对话,避免监管碎片化。

3. 社会适应:培养AI时代的人才

加强STEM教育培养AI时代人才,开展职业再培训计划助力劳动者转型,提升公众对AI技术的认知与信任。例如,某制造企业成立AI创新中心,推动AI在研发、生产、销售全链条落地,实现从“流程驱动”到“数智驱动”的运营模式转型。

科技向善的终极目标

AI的终极价值,不在于替代人类,而在于赋予人类更强大的创造力。从蒸汽机到互联网,每一次技术革命都伴随争议,但最终推动了人类文明的进步。AI亦如此——它既是解放生产力的利器,也是考验人类智慧的试金石。唯有通过技术创新、伦理约束与政策引导的协同,才能让AI成为“增强人类”而非“替代人类”的工具,最终实现“科技向善”的终极目标。正如Deepseek团队所言:“AI不是要取代人类,而是要赋予每个人超能力。”在这场智能革命中,我们无需抗拒其颠覆性,也不能盲目乐观其完美性。唯有理性应对,方能书写属于人类的智能时代新篇章。

郑重声明:此文内容为本网站转载企业宣传资讯,目的在于传播更多信息,与本站立场无关。仅供读者参考,并请自行核实相关内容。